Suscríbase a nuestros boletines diarios y semanales para recibir las últimas actualizaciones y contenido exclusivo que cubre IA de vanguardia. Más información

Microsoft es un gran patrocinador y socio de OpenAI, pero eso no significa que quiera dejar que esta última empresa se apodere del mercado de la IA generativa.

Como prueba, Microsoft anunció hoy una nueva forma de perfeccionar su pequeño modelo de lenguaje Phi-3 sin que los desarrolladores tengan que gestionar sus propios servidores, y de forma gratuita (inicialmente).

El ajuste se refiere al proceso de adaptación de un modelo de IA. a través de indicaciones del sistema o ajustar sus pesos subyacentes (parámetros) para que se comporte de manera diferente y más óptima para casos de uso específicos y usuarios finales, incluso agregando nuevas funciones.

¿Qué es Phi-3?

La compañía presentó Phi-3, un modelo de 3 mil millones de parámetros, en abril pasado como una opción de bajo costo y de nivel empresarial para que desarrolladores externos creen nuevas aplicaciones y software.

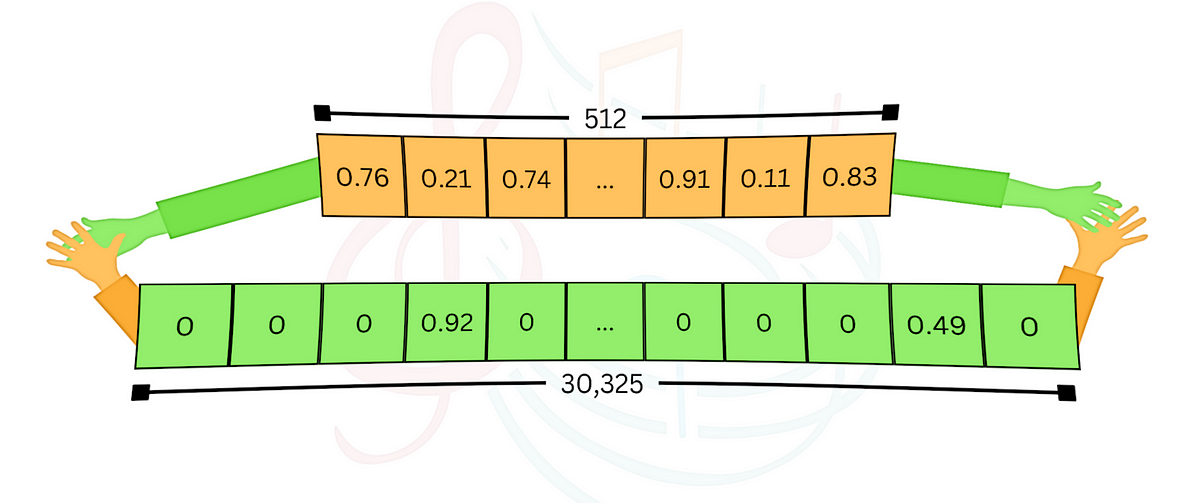

Aunque es considerablemente más pequeño que la mayoría de los otros modelos de lenguaje importantes (Llama 3.1 de Meta, por ejemplo, viene en una versión de 405 mil millones de parámetros; los parámetros son los «ajustes» que guían el procesamiento y las respuestas de la red neuronal), Phi-3 tuvo un desempeño al nivel de OpenAI. Modelo GPT-3.5, según los comentarios proporcionados a VentureBeat en ese momento por Sebastien Bubeck, vicepresidente de IA generativa de Microsoft.

Específicamente, Phi-3 fue diseñado para ofrecer un rendimiento asequible en codificación, razonamiento con sentido común y conocimiento general.

Ahora se trata de una familia completa que consta de 6 modelos distintos con diferentes números de parámetros y longitudes de contexto (la cantidad de tokens o representaciones numéricas de datos) que el usuario puede proporcionar en una sola entrada, esta última oscilando entre 4.000 y 128.000, con costos. que van desde $ 0,0003 por 1000 tokens de entrada hasta $ 0,0005 por 1000 tokens de entrada.

Sin embargo, cuando se agrega el precio de token más típico «por millón», para empezar resulta $ 0,3/$ 0,9 por millón de tokens, exactamente el doble del nuevo precio mini GPT-4o de OpenAI para tokens de entrada y aproximadamente 1,5 veces más caro. para tokens de salida.

Phi-3 fue diseñado para un uso seguro por parte de las empresas, con salvaguardias para reducir los prejuicios y la toxicidad. Incluso cuando se anunció por primera vez, Bubeck de Microsoft promocionó su capacidad para ajustarse a casos de uso empresariales específicos.

«Puede tomar sus datos y refinar ese modelo general, y obtener un rendimiento sorprendente en sectores verticales estrechos», nos dijo.

Pero en ese momento, no había opciones sin servidor para perfeccionarlo: si querías hacerlo, tenías que configurar tu propio servidor Microsoft Azure o descargar el modelo y ejecutarlo en tu propia máquina local, que tal vez no tenía Sin espacio suficiente.

El ajuste fino sin servidor abre nuevas opciones

Hoy, sin embargo, Microsoft anunció la disponibilidad pública general de sus «modelos como servicio (punto final sin servidor)». su plataforma de desarrollo de IA Azure.

También anunció que “Phi-3-small ahora está disponible a través de un punto final sin servidor para que los desarrolladores puedan iniciar rápida y fácilmente el desarrollo de IA sin tener que administrar la infraestructura subyacente. »

Phi-3-vision, que puede manejar entradas de imágenes, «pronto también estará disponible a través de un punto final sin servidor», según la publicación del blog de Microsoft.

Pero estos modelos simplemente están disponibles «tal cual» a través de la plataforma de desarrollo de IA Azure de Microsoft. Los desarrolladores pueden crear aplicaciones sobre estas plantillas, pero no pueden crear sus propias versiones de las plantillas adaptadas a sus propios casos de uso.

Para los desarrolladores que quieran lograr esto, Microsoft dice que deberían buscar el Phi-3-mini y el Phi-3-medium, que pueden perfeccionarse con «datos de terceros para crear experiencias de IA más relevantes para sus necesidades». de forma segura y económica.

“Dado su pequeño espacio informático y su compatibilidad con la nube y los dispositivos, los modelos Phi-3 son muy adecuados para realizar ajustes para mejorar el rendimiento del modelo base en una variedad de escenarios, incluido el aprendizaje de una nueva habilidad o tarea (por ejemplo, tutoría). o mejorar la coherencia y calidad de las respuestas (por ejemplo, tono o estilo de respuestas en el chat/preguntas-respuestas)”, escribe la empresa.

Específicamente, Microsoft dice que la empresa de software educativo Khan Academy ya está utilizando un Phi-3 perfeccionado para evaluar el rendimiento de su Khanmigo for Teachers impulsado por Microsoft. Servicio Azure OpenAI.

Una nueva guerra de precios y capacidad para los desarrolladores de IA empresarial

El precio del ajuste fino sin servidor Phi-3-mini-4k-instruct comienza en $0,004 por 1000 tokens ($4 por 1 millón de tokens), mientras que aún no se ha incluido ningún precio para el modelo mediano.

Si bien esta es una clara victoria para los desarrolladores que buscan permanecer en el ecosistema de Microsoft, también es un contendiente notable para los esfuerzos del aliado de Microsoft, OpenAI, para capturar desarrolladores de IA empresarial.

Y OpenAI anunció hace unos días el ajuste gratuito de GPT-4o mini hasta 2 millones de tokens por día hasta el 23 de septiembre, por los llamados usuarios de “Nivel 4 y 5” de su interfaz de programación de aplicaciones (API)o aquellos que gastan al menos $250 o $1,000 en créditos API.

Después del lanzamiento por parte de Meta de la familia Llama 3.1 de código abierto y el nuevo modelo Mistral Large 2 de Mistral, los cuales también pueden ajustarse para diferentes usos, está claro que la carrera para ofrecer opciones convincentes de IA para el desarrollo de software en el negocio está en pleno apogeo. – y los proveedores de IA están cortejando a los desarrolladores con modelos grandes y pequeños.